工作中,数据重复很常见,它会影响分析结果,甚至导致决策失误,学会筛选重复数据,是数据处理的基本功,也是提升效率的关键,今天,我们就来聊聊,如何快速、准确地找出并处理那些“捣乱”的重复项。

1、明确目标,定义何为“重复”

筛选前,先要明确标准,什么是重复数据,有时,两行数据完全一样,这很好判断,但有时,只有部分关键字段相同,比如,姓名和电话一样,但地址不同,这时,就需要你定义清楚,根据业务需求,确定判断依据,是全部字段匹配,还是部分字段匹配,定义清晰,才能精准筛选,避免误删或遗漏。

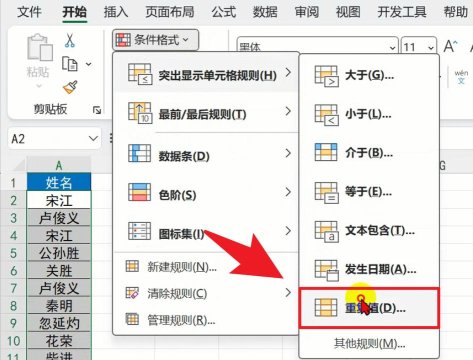

2、巧用工具,Excel是首选利器

对于大多数人,Excel最方便,它的“删除重复项”功能,简单又强大,选中数据区域,点击这个功能,选择依据的列,就能一键删除,如果想先查看,可以用“条件格式”,高亮显示重复值,这样,重复项一目了然,方便你后续处理,高级筛选也能帮上忙,设置好条件,就能提取唯一值,或者,标记出重复记录。

3、SQL查询,处理数据库的专家

如果数据量很大,或者存储在数据库里,SQL就是最佳选择,使用GROUP BY和HAVING子句,可以轻松找出重复行,比如,按姓名分组,统计数量大于1的记录,这些就是重复的,你还可以用ROW_NUMBER()窗口函数,给每组重复数据编号,然后,只保留编号为1的行,从而删除其他重复项,这种方法,灵活且高效。

4、编程处理,Python与Pandas组合

对于复杂场景,编程更灵活,Python的Pandas库,是数据处理的神器,使用Dataframe的duplicated()方法,可以标记重复行,或者,用drop_duplicates()直接删除,你可以指定列,也可以考虑所有列,还能选择保留第一条,还是最后一条记录,如果数据需要清洗,比如,去除空格、统一格式,再判断重复,编程都能轻松实现。

筛选重复数据,方法很多,关键要匹配你的需求,从简单的Excel,到专业的SQL,再到灵活的Python,工具各有优势,掌握它们,你就能从容应对,各种数据重复的挑战,让数据变得更干净,分析更准确,决策更可靠。